自动驾驶商业化进程正加速推进,但行业面临的“最后1%”长尾场景难题,正成为制约高阶自动驾驶规模化落地的关键瓶颈。特斯拉、百度、小马智行等头部企业虽已在多地开展“车内无人”运营测试,工信部也于近期发布首批L3级自动驾驶车型准入许可,但极端天气、不规则障碍物、突发动态目标等低概率高风险场景,仍让现有感知系统在可靠性上与人类驾驶存在显著差距。

特斯拉CEO马斯克曾指出,实现无监督自动驾驶需约100亿英里训练数据,这一论断直指行业核心挑战——现实道路的极端复杂性远超现有技术覆盖范围。百度测试数据显示,L3级系统在暴雨、强逆光等场景下的通过率仅75%-85%,较人类驾驶员98%的水平存在明显差距。传统视觉传感器在复杂环境中的性能衰减尤为突出:暴雨时识别距离下降60%,强逆光下图像过曝导致目标丢失,这些缺陷源于帧式相机“连续成像”的技术路径局限。

突破物理极限成为行业共识。研究机构Gartner的报告显示,感知系统极端环境适应能力仍处于技术成熟度曲线的“爬升期”,距离大规模应用尚需3-5年。在此背景下,事件相机(DVS)技术凭借其独特的“动态触发”机制,正从实验室走向产业实践。与传统相机以固定帧率采集图像不同,DVS仅在像素亮度变化超过阈值时输出信号,这种“按需响应”模式使其具备微秒级响应速度、120-140分贝超高动态范围,以及低数据冗余等优势。

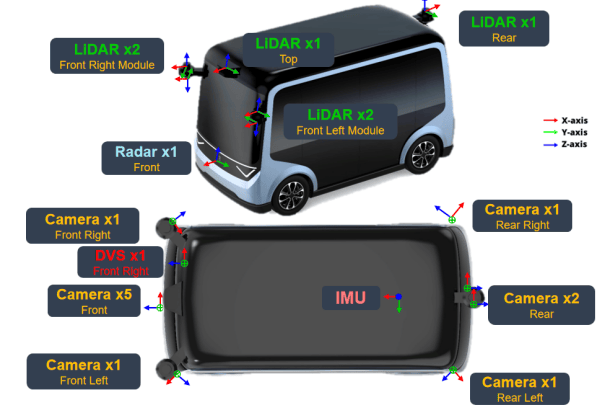

2026年初,国内某机场自动驾驶测试场景中,一套搭载DVS多模融合传感器的系统完成全球首次L4级商用验证。该系统在原有激光雷达、RGB相机、毫米波雷达架构基础上,新增DVS作为“高速触发层”。当强逆光导致传统视觉系统失效时,DVS可实时捕捉动态变化,将“鬼探头”行人或突发异物的识别时间缩短至30毫秒内,较传统方案提升数倍。测试数据显示,夜间低照度环境下,系统对突然闯入车辆的行人识别准确率提升40%;白天强光场景中,对砖块大小异物的检测距离延长至50米外。

这项技术突破源于产学研深度协同。柏锐智芯科技联合电子科技大学、时识科技等机构,攻克了事件视觉与现有传感器的时空同步、数据融合等工程难题。项目负责人表示,DVS并非要替代传统视觉,而是通过捕捉场景动态变化,为系统提供“第二重保险”。这种技术路径在数据依赖度上显著低于纯算法优化方案,尤其适合应对未被训练数据覆盖的极端场景。

市场数据印证了技术趋势。全球动态视觉传感器市场规模预计从2025年的13.4亿美元增至2026年的14.9亿美元,年复合增长率达11.2%。除自动驾驶外,具身智能机器人、低空经济等领域对低延迟视觉系统的需求也在激增。在工业自动化场景中,DVS已实现对高速运动部件的实时缺陷检测;在物流机器人领域,其抗眩光特性使分拣效率提升25%。随着技术成熟度提升,这场由“被动成像”向“主动感知”的变革,正在重塑智能系统的底层逻辑。